Langchain的向量存储 – 基本概念和示例

文章目录

- 前言

- 一、 主要功能

- 二、 典型用例

- 三、 使用示例

- 四、 支持的向量存储后端

前言

之前在下面两篇文章里面讲了Token Embeddings的原理

- 一起学习大模型 – 从底层了解Token Embeddings的原理(1)

- 一起学习大模型 – 从底层了解Token Embeddings的原理(2)

我们不光学习原理,还要把它运用起来。今天我们学习如何在Langchain里实现向量存储和向量检索。

LangChain 是一个用于构建和使用大语言模型(LLMs)的框架,它为构建自然语言处理应用程序提供了多种工具和功能。其中,向量存储(Vector Store)是 LangChain 的一个重要组件,用于存储和检索文本的向量表示。

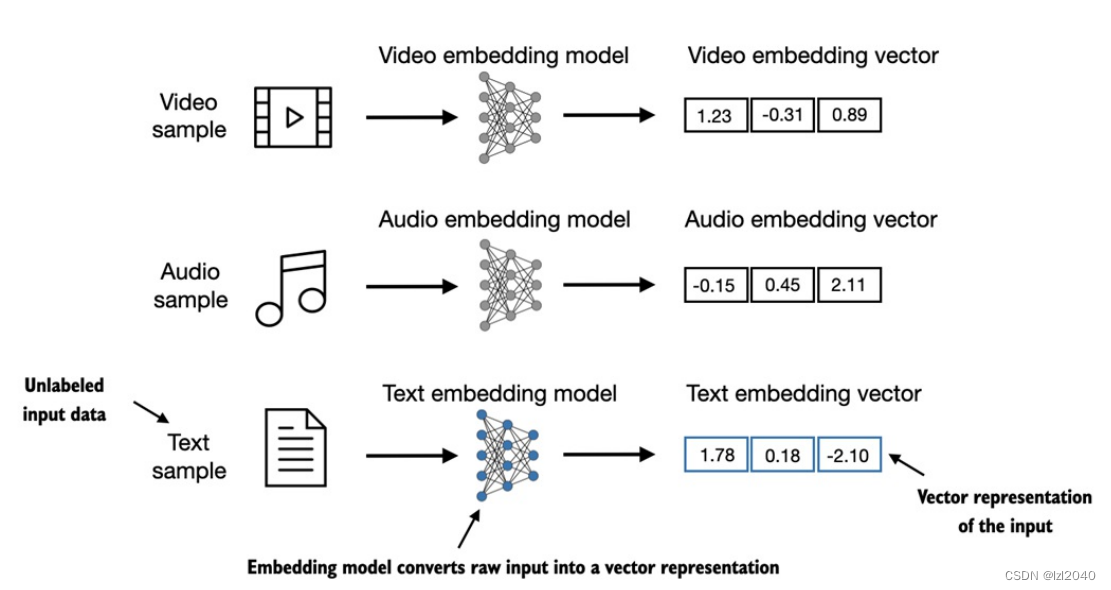

向量存储的基本思想是将文本数据转换为向量(通常是高维数值数组),然后将这些向量存储在数据库或索引中,以便后续快速检索和相似性搜索。

一、 主要功能

向量化文本:

- LangChain 提供了与各种嵌入模型的集成,可以将文本数据转换为向量表示。这些嵌入模型可以是预训练的语言模型,如 BERT、GPT 等,也可以是自定义训练的模型。

存储向量:

- 向量存储可以将生成的向量保存在不同类型的数据库中,如内存数据库、文件系统、SQL 数据库、NoSQL 数据库等。LangChain 提供了对多种存储后端的支持。

相似性搜索:

- 向量存储的一个重要功能是根据查询向量进行相似性搜索,即查找与查询向量最相似的存储向量。常用的方法包括余弦相似度、内积、欧氏距离等。

索引和优化:

- 为了提高检索速度,LangChain 支持多种索引结构和优化技术,如 KD 树、Ball 树、Annoy、FAISS 等。

二、 典型用例

文档检索:

- 使用向量存储,可以将大规模文档集合转换为向量,并在用户查询时快速找到最相关的文档。

问答系统:

- 将问题和答案对转换为向量,用户提问时,系统可以快速找到最匹配的答案。

推荐系统:

- 根据用户的历史行为向量,为用户推荐最相似的物品。

三、 使用示例

以下是一个使用 LangChain 向量存储的简单示例:

from langchain.embeddings import OpenAIEmbeddings

from langchain.vectorstores import FAISS

# 假设我们有一些文本数据

texts = ["Hello world", "Machine learning is fun", "LangChain is awesome"]

# 初始化嵌入模型

embeddings = OpenAIEmbeddings()

# 将文本数据转换为向量

vectors = [embeddings.embed(text) for text in texts]

# 使用 FAISS 存储向量

vector_store = FAISS()

for vector, text in zip(vectors, texts):

vector_store.add_vector(vector, text)

# 查询相似文本

query_text = "I love learning"

query_vector = embeddings.embed(query_text)

results = vector_store.similarity_search(query_vector)

print("Most similar texts:", results)

四、 支持的向量存储后端

LangChain 支持多种向量存储后端,包括但不限于:

- FAISS:Facebook AI 提供的高效相似性搜索库。

- Annoy:Spotify 开源的近似最近邻搜索库。

- HNSWLib:基于小世界图的高效近似最近邻搜索库。

- Elasticsearch:支持向量搜索的全文检索引擎。

通过向量存储,LangChain 可以显著提升基于文本数据的检索和推荐系统的性能和效果,是构建智能应用的重要工具。